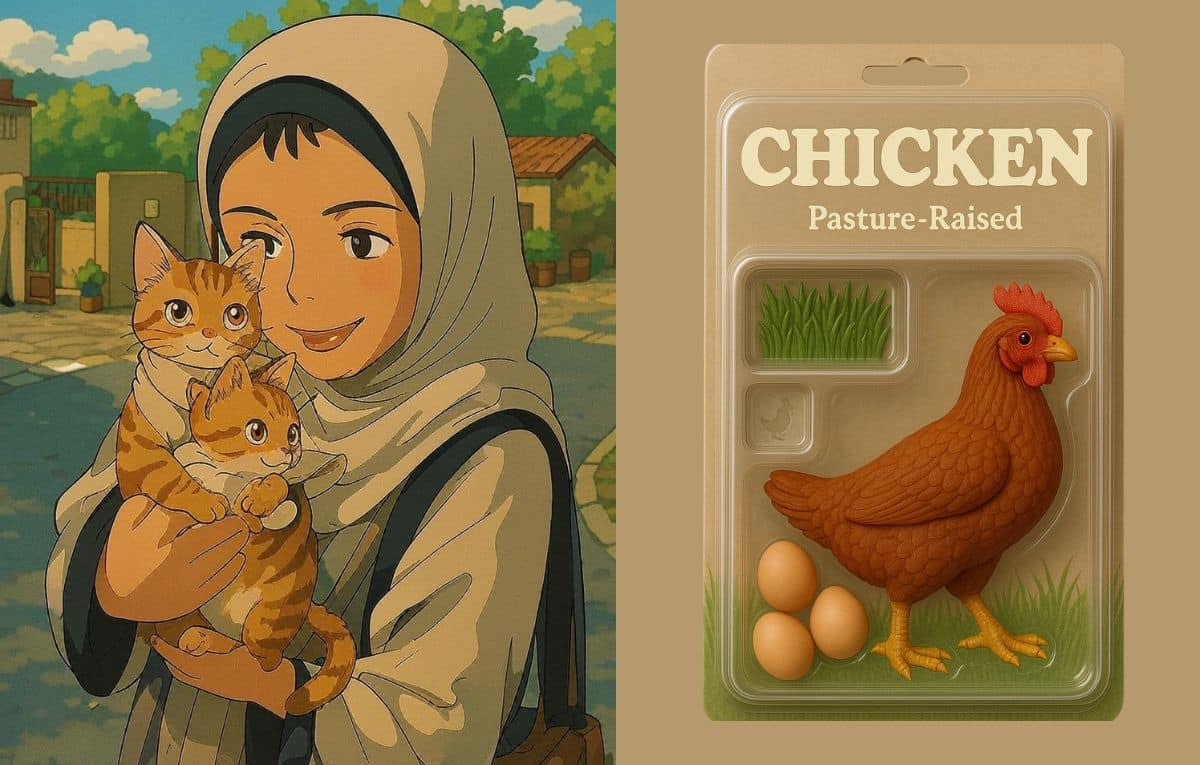

بعد الزخم المؤقت الذي أحدثته صيحة توليد صور الذكاء الاصطناعي بأسلوب (استديو جيبلي) Studio Ghibli، التي اجتاحت منصات التواصل الاجتماعي في نهاية شهر مارس الماضي، سرعان ما وجدت أدوات الذكاء الاصطناعي التوليدي، وفي مقدمتها ChatGPT، وسيلة جديدة لجذب المستخدمين وحثهم على تحميل صورهم الشخصية في أنظمتها. وهذه المرة، كان الهدف هو تحويل صور المستخدمين إلى نسخ رقمية يظهرون فيها على هيئة ألعاب داخل صناديق صغيرة ومعهم بعض الأدوات المرتبطة بعملهم الذي يمارسونه، وقد أُطلق على هذا التوجه الجديد اسم (AI doll) أو (Barbie box trend).

وتتبع هذه الصيحات الرقمية عادةً مسارًا بسيطًا ومكررًا، إذ تبدأ العملية برفع المستخدم لصورة شخصية في الأداة أو التطبيق المخصص مع كتابة بعض الأوامر النصية التوجيهية لتحويل الصورة إلى دمية معلبة تشبه دمى (باربي) الشهيرة أو شخصيات الأكشن ذات المظهر الكرتوني، مصحوبة بإكسسوارات تعكس اهتماماتك أو طبيعة عملك. والخطوة النهائية التي يتوقعها الجميع؟ بالطبع، مشاركة النتيجة المبهرة عبر منصات التواصل الاجتماعي بهدف زيادة التفاعل.

ومع تزايد انتشار هذه الصور وملء صفحات الأخبار بها، يتزايد القلق بشأن تداعياتها، فالأمر لا يقتصر على كونها مجرد صيحة جديدة تسيء استخدام إمكانيات الذكاء الاصطناعي، بل يتعداه إلى موافقة ملايين الأشخاص على مشاركة وجوههم ومعلوماتهم الحساسة طواعيةً، فقط للحاق بالركب الاجتماعي، الذي يفرض نفسه بقوة على المنصات الرقمية، دون أدنى تفكير في مخاطر الخصوصية والأمان المترتبة على ذلك.

خدعة الخصوصية.. موافقة بلا وعي:

لقد ساهمت صيحات توليد الصور بالذكاء الاصطناعي، مثل: الصور المولدة بأسلوب الدمى (AI doll)، أو بأسلوب استوديو جيبلي بنحو كبير في تغذية قواعد بيانات شركات مثل: OpenAI و xAI، وغيرها من شركات الذكاء الاصطناعي بكميات ضخمة من الصور الشخصية.

والمثير للدهشة أن العديد من المشاركين في هذه الصيحات ربما لم يستخدموا برامج النماذج اللغوية الكبيرة من قبل على الإطلاق، مما يشير إلى أن الدافع الرئيسي كان الانضمام إلى الضجة المنتشرة عبر منصات التواصل الاجتماعي، وليس الاهتمام بالتكنولوجيا بحد ذاتها أو فهم كيفية عملها. وقد أصبح المشهد مقلقًا للغاية خلال الأيام الماضية عند رؤية العديد من العائلات الذين رفعوا صور أطفالهم للحصول على هذه الصور ومشاركتها بدون وعي.

قد يعتقد الكثير من الأفراد أن عملية تحميل صورة شخصية إلى برنامج ذكاء اصطناعي متخصص في توليد الصور لا تختلف كثيرًا عن مجرد مشاركة صورة شخصية عبر إنستاجرام، وقد يعزز هذا الاعتقاد لديهم أن نماذج الذكاء الاصطناعي الكبرى معروفة بالفعل بجمع البيانات والصور من الويب.

ولكن هنا يكمن الفخ الأكبر، فمن خلال تحميل صورك طوعًا إلى برامج توليد الصور بالذكاء الاصطناعي، فإنك تمنح مزود الخدمة مزيدًا من الطرق القانونية لاستخدام تلك المعلومات، أو بمعنى أدق، استخدام وجهك أو البيانات البيومترية الفريدة المستمدة منه، لأغراض قد تتجاوز بكثير مجرد إنشاء الصورة الفنية التي طلبتها في البداية، فقد تُستخدم هذه البيانات في تدريب النماذج المستقبلية أو لأغراض تجارية أو تحليلية أخرى وفقًا لبنود الخدمة التي غالبًا ما يوافق عليها المستخدمون دون قراءتها بتأنٍ.

وقد أوضحت لويزا جاروفسكي، المؤسسة المشاركة لأكاديمية الذكاء الاصطناعي والتكنولوجيا والخصوصية، أن انتشار صيحات الصور هذه بنحو واسع يعني أن المستخدمين، بمشاركتهم الطوعية لمعلوماتهم، يمنحون شركات الذكاء الاصطناعي مثل (OpenAI) موافقة صريحة على معالجة تلك البيانات. ويتجاوز هذا الفعل الحماية التي توفرها اللائحة العامة لحماية البيانات (GDPR) تحت بند (المصالح المشروعة) legitimate interest، مما يسمح لهذه الشركات باستخدام الصور بطرق قانونية قد لا يتوقعها المستخدمون.

🚨 Most people haven’t realized that the Ghibli Effect is not only an AI copyright controversy but also OpenAI’s PR trick to get access to thousands of new personal images; here’s how:

To get their own Ghibli (or Sesame Street) version, thousands of people are now voluntarily… pic.twitter.com/zBktscNOSh

— Luiza Jarovsky (@LuizaJarovsky) March 29, 2025

وقد وصفت جاروفسكي الأمر بأنه (خدعة خصوصية ذكية)، أتاحت لشركات الذكاء الاصطناعي جمع كميات ضخمة من الصور الجديدة لتدريب نماذجها وتطويرها أو ربما تستخدمها في أغراض أخرى غير معلنة.

ويمكننا القول إن نجاح هذه الإستراتيجية في صيحة توليد الصور بأسلوب جيبلي دفع الشركات إلى رفع المستوى بإطلاق صيحة الصور المولدة بأسلوب الدمى، التي لا تتطلب رفع الصور الشخصية فقط، بل تتطلب أيضًا إدخال تفاصيل شخصية إضافية عن العمل والاهتمامات.

فقدان السيطرة الكاملة على بياناتك:

لإنشاء شخصيتك الرقمية المتحركة المخصصة لك بدقة عالية بأسلوب الدمى، لا يكفي مجرد تحميل صورتك، بل يتطلب الأمر منك مشاركة بعض المعلومات التفصيلية عن نفسك – التي تتضمن طبيعة عملك واهتماماتك الشخصية وهواياتك المفضلة خارج نطاق العمل وأي تفاصيل أخرى ترغب في عكسها في شخصيتك الرقمية – لتوليد الحزمة الكاملة والإكسسوارات المصاحبة، فكلما قدمت تفاصيل أكثر، زاد الشبه بين الشخصية الناتجة وشخصيتك الحقيقية واهتماماتك.

وبناءً على ذلك، فإن المشكلة لا تقتصر على مجرد منح المستخدمين موافقة ضمنية أو صريحة لشركات الذكاء الاصطناعي على استخدام بيانات وجوههم لأغراض توليد الصور؛ بل يشمل أيضًا تزويد هذه الشركات بكمية كبيرة وغير مسبوقة من المعلومات الشخصية الوصفية والسياقية، التي لا يمكن لأنظمة الذكاء الاصطناعي، في معظم الحالات، جمعها أو استنتاجها بدقة بأي طريقة أخرى.

ويحذر إيمون ماغواير، رئيس قسم أمن الحسابات في شركة (Proton) من أن مشاركة هذه المعلومات الشخصية يفتح صندوق باندورا من المشكلات التي لا حصر لها، والتي لا يمكن التنبؤ بها حاليًا.

ويكمن السبب الرئيسي في ذلك في فقدان السيطرة الكاملة على بياناتك، والأهم من ذلك، على كيفية استخدامها في المستقبل، فقد تُستخدم هذه البيانات لتدريب النماذج اللغوية الكبيرة، أو لتوليد محتوى جديد، أو لتخصيص الإعلانات الموجهة، أو لأغراض أخرى متعددة، ولن يكون لديك الحق في اتخاذ قرار بشأن أي من هذه الاستخدامات.

وقال ماغواير موضحًا خطورة الموقف: “الملفات الشخصية والسلوكية التفصيلية التي يمكن لأدوات مثل ChatGPT إنشاؤها باستخدام هذه المعلومات قد تؤثر في جوانب حاسمة في حياتك بما يشمل: تغطية التأمين، وشروط الإقراض، والمراقبة، والتحليل السلوكي (profiling)، وجمع المعلومات الاستخباراتية، وحتى الهجمات السيبرانية الموجهة”.

ومع ذلك تُعدّ قضية الخصوصية المرتبطة بكيفية استخدام أو إساءة استخدام، شركات مثل: OpenAI وجوجل ومايكروسوفت وإكس، لهذه البيانات هي جانب واحد فقط من المشكلة، فهذه الأدوات التي تجمع كميات ضخمة من البيانات الشخصية ستتحول بمرور الوقت إلى أهداف مغرية للقراصنة. والمثير للقلق أن شركات الذكاء الاصطناعي ليست نموذجًا يُحتذى به في تأمين بيانات مستخدميها.

وفي هذا السياق، استشهد ماغواير بحادثتين بارزتين: الأولى: حادثة شركة (DeepSeek) التي تسبب في إتاحة قاعدة بيانات مستخدميها علنًا عبر الإنترنت، والثانية: حادثة شركة (OpenAI)، التي تعرضت فيها إحدى المكتبات التي استخدمتها لثغرة أمنية أدت إلى كشف بيانات مستخدمين حساسة، بما يشمل: الأسماء، وعناوين البريد الإلكتروني، ومعلومات بطاقة الائتمان.

وفي مثل هذه الحالات، يمكن للقراصنة استغلال الصور والمعلومات الشخصية لأغراض خبيثة، مثل: الدعاية السياسية المضللة، وسرقة الهوية، وعمليات الاحتيال المالية، والاحتيال عبر الإنترنت، مما يجعل هذه الصيحات ليست مجرد مخاطر خصوصية، بل تهديدات أمنية حقيقية.

الاستهلاك الضخم للطاقة.. تهديد بيئي متزايد:

لم يقتصر استخدام هذه الصيحات الرقمية على الأفراد العاديين فحسب، بل سارعت العديد من العلامات التجارية المعروفة والجهات الحكومية إلى تبني استخدامها في حملاتها التسويقية، مما يدل على الجاذبية الكبيرة لهذه الموجة الرقمية وسرعة انتشارها.

We had to get in on the toy action figure trend! 🚀🪀🧸

We love it! What do you think? 👇 pic.twitter.com/YUKnfbcJQY

— Royal Mail (@RoyalMail) April 9, 2025

وبينما يستمتع الكثيرون بالطابع المرح لهذه الصيحات الجديدة، بدأت تظهر أصوات ناقدة تعبر عن قلقها بشأن التأثير البيئي لها، إذ تشير البروفيسورة جينا نيف من جامعة كوين ماري في لندن إلى أن ChatGPT يستهلك كميات ضخمة من الطاقة، وأن مراكز البيانات التي تدعم تشغيله تستهلك كهرباء في عام واحد أكثر مما تستهلكه 117 دولة مجتمعة.

ويستدعي هذا الواقع تساؤلات حاسمة حول ممارسات الطاقة المستدامة، خاصة عندما يتعلق الأمر بتطبيقات الذكاء الاصطناعي التي قد لا تُعدّ حيوية ضمن المنظومة التقنية.

هل تستحق التسلية العابرة الثمن الباهظ الذي ندفعه؟

لقد أصبح تجنب مشاركة المعلومات الشخصية والبقاء مجهول الهوية عبر الإنترنت أمرًا صعبًا للغاية الآن في هذا العالم الرقمي، ومع ذلك، تظهر صيحات الصور المولدة الذكاء الاصطناعي السريعة الانتشار هذه بوضوح أن معظم الناس لا يأخذون التبعات المتعلقة بالخصوصية والأمان على محمل الجد، فمع تزايد الوعي بأهمية استخدام أدوات لحماية الخصوصية، يبدو أن إغراء الانضمام إلى أحدث موجة اجتماعية يتغلب على الحذر.

وتدرك شركات الذكاء الاصطناعي هذه الديناميكية النفسية والاجتماعية لدى المستخدمين جيدًا وقد أتقنت فن استغلالها لصالحها، فمن خلال تقديم تجارب رقمية مصممة خصوصًا لتكون ممتعة وجذابة للغاية بصريًا وسهلة الاستخدام في الوقت نفسه، تنجح هذه الشركات في جذب ملايين المستخدمين الجدد، وجمع كميات ضخمة من البيانات القيمة والحساسة التي لا يمكن الحصول عليها بسهولة بطرق أخرى تقليدية.

ويمكن القول إن الازدهار السريع لصيحات توليد الصور بأسلوب جيبلي وأسلوب الدمى ليس سوى بداية لمرحلة جديدة في تطور الذكاء الاصطناعي التوليدي وتهديده المتزايد للخصوصية، ومن المؤكد أننا سنشهد المزيد من هذه الصيحات التي تنتشر بسرعة البرق بين مستخدمي منصات التواصل الاجتماعي في الأشهر القادمة.

وفي الختام، تتجاوز صيحات صور الذكاء الاصطناعي مجرد كونها ظاهرة ممتعة عبر منصات التواصل الاجتماعي، بل تمثل نقطة انطلاق لنقاشات جادة وملحة حول التكاليف الخفية للابتكارات المدفوعة بالذكاء الاصطناعي، سواء كانت بيئية، أو أخلاقية، أو تتعلق بكيفية تخصيص مواردنا الحاسوبية المحدودة بنحو أكثر مسؤولية وفعالية لتحقيق تقدم حقيقي ومستدام يفيد البشرية جمعاء.

أخبار البيانات المزروعة ابق على اطلاع على آخر الأخبار المحلية والعالمية لحظة بلحظة، واقرأ المزيد عن السياسة والصحة والاقتصاد والرياضة والمزيد.

أخبار البيانات المزروعة ابق على اطلاع على آخر الأخبار المحلية والعالمية لحظة بلحظة، واقرأ المزيد عن السياسة والصحة والاقتصاد والرياضة والمزيد.